En el ámbito de la AI Compliance, los riesgos de los falsos negativos están emergiendo como una amenaza significativa para las empresas. Esta situación deja a las organizaciones expuestas a sanciones regulatorias y a posibles daños reputacionales debido a riesgos no detectados. La integración de la supervisión humana es esencial para mitigar estos peligros y asegurar el cumplimiento normativo de manera efectiva.

AI Compliance: Entendiendo el Peligro de los Falsos Negativos

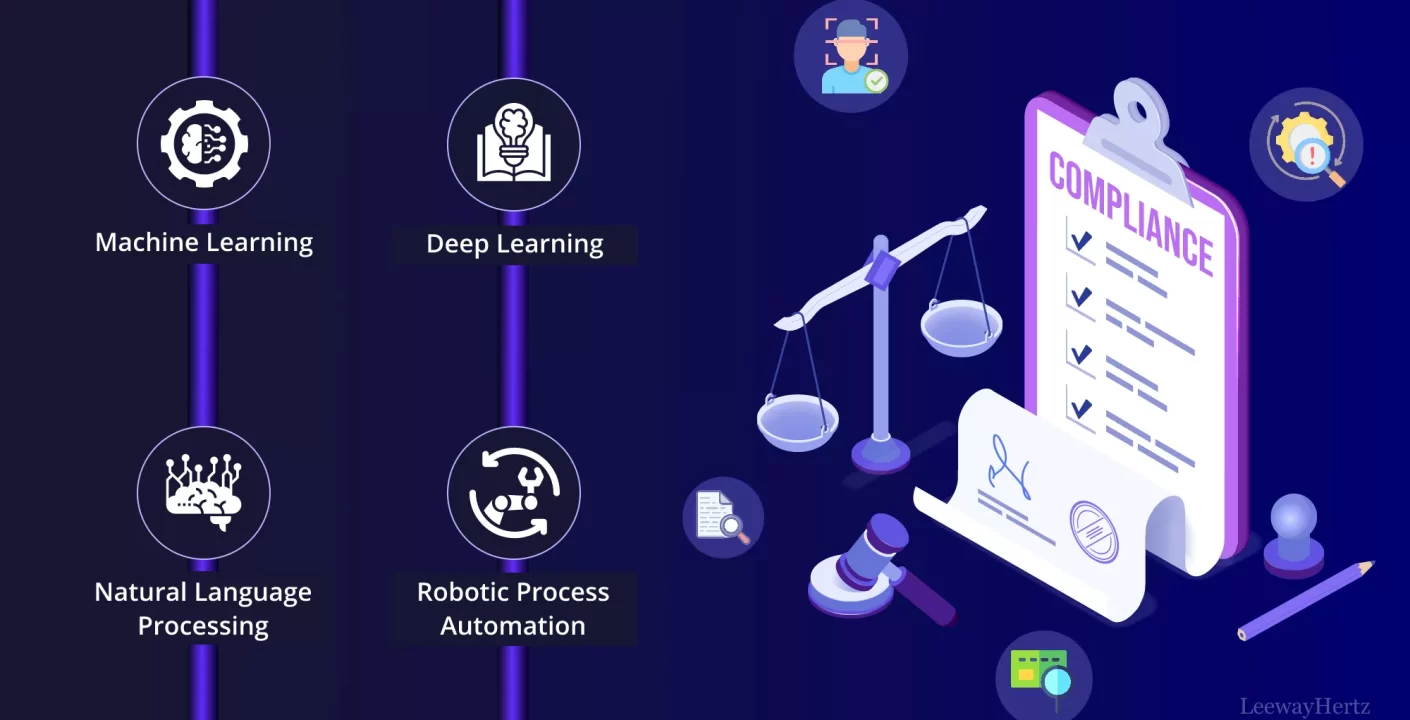

El concepto de AI Compliance ha ganado relevancia en los últimos años, especialmente en el marco del cumplimiento normativo. Sin embargo, los falsos negativos, donde un sistema de inteligencia artificial no detecta un riesgo, resultan ser más preocupantes que los falsos positivos. Estos últimos, aunque inconvenientes, pueden corregirse con intervención humana. El desafío con los falsos negativos es que pueden pasar desapercibidos, exponiendo a la empresa a serias repercusiones regulatorias.

Factores que Incrementan los Falsos Negativos

Harsh Pandya, director de producto en Saifr, subraya la problemática de la reducción de falsos positivos en sistemas de AI, que puede dar una falsa impresión de mejora al ocultar serias brechas. Además, RelyComply explica que eventos geopolíticos recientes y la pandemia de covid-19 han incrementado significativamente el número de individuos sancionados y las transacciones de pagos online, aumentando así el riesgo de falsos negativos. Estos factores externos, junto a limitaciones tecnológicas como configuraciones inadecuadas y datos sesgados, impactan negativamente la precisión de los modelos AI.

Mitigación de los Riesgos mediante Supervisión Humana

Supradeep Appikonda, COO de 4CRisk.ai, enfatiza la necesidad de la supervisión humana para gestionar los falsos negativos. La supervisión no solo debe estar presente en la revisión de alertas, sino también en la auditoría transparente y la validación del modelo. Las pruebas contrafactuales y el entrenamiento continuo son esenciales para asegurar que los modelos se mantengan adecuados ante nuevos contextos reguladores y cambios en el entorno operativo.

Modelos Especializados para AI Compliance

Para enfrentar los desafíos actuales, Appikonda sugiere utilizar modelos de lenguaje privados y especializados. Estos modelos pueden reducir significativamente los puntos ciegos, asegurando que la inteligencia artificial esté alineada con el entorno normativo y las necesidades específicas de cada empresa. Esto no solo mejora la capacidad de detección de riesgos, sino que también aumenta la confianza en el uso de AI en cumplimiento normativo.

Concluyendo: El Futuro de la AI Compliance

Si bien la tecnología continúa avanzando, la integración de la inteligencia artificial en el cumplimiento normativo debe hacerse con precaución. Los falsos negativos representan un riesgo latente que las empresas no pueden permitirse ignorar. La clave para un enfoque equilibrado reside en combinar los últimos avances tecnológicos con la supervisión humana, asegurando que las herramientas de AI Compliance ofrezcan seguridad y precaución en igual medida.