En un giro que revela la complejidad de la interacción humana con las tecnologías emergentes, OpenAI ha comunicado preocupantes estadísticas sobre el uso de ChatGPT para enfrentar crisis personales, incluyendo el suicidio. La frase clave “Suicidio ChatGPT” destaca la preocupante tendencia de cómo más de un millón de personas utilizan esta herramienta cada semana para discutir temas suicidas.

Desentrañando el Impacto de Suicidio ChatGPT en la Salud Mental

Con más de 800 millones de usuarios activos semanalmente, el alcance de ChatGPT es vasto. Sin embargo, un 0.15% de estas interacciones son indicios explícitos de planificación suicida, lo que subraya la importancia de desarrollar respuestas más sensibles y adecuadas. La colaboración con 170 expertos en salud mental ha sido crucial para avanzar en este terreno, mejorando las respuestas de la inteligencia artificial.

Mejoras Significativas en la Interacción de ChatGPT

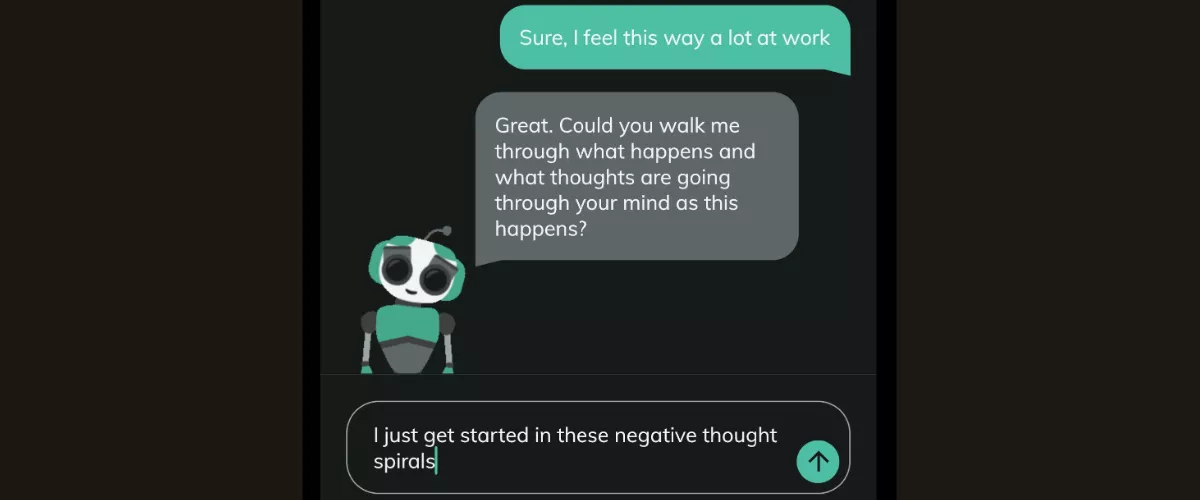

Con el lanzamiento de GPT-5, OpenAI ha logrado que las respuestas a conversaciones sobre suicidio sean un 65% más apropiadas y consistentes en comparación con versiones anteriores. Estas mejoras no solo reflejan un compromiso con la seguridad del usuario, sino que también muestran el potencial de la inteligencia artificial para actuar de manera responsable en situaciones de crisis.

Desafíos Legales y Responsabilidad

A pesar de estos avances, el camino no ha estado exento de dificultades. OpenAI enfrenta una demanda por parte de los padres de un adolescente que discutió pensamientos suicidas con el chatbot antes de su trágica muerte. Esto subraya la necesidad de estrategias de protección más robustas, especialmente para los usuarios más jóvenes.

Protección de Usuarios Jóvenes de ChatGPT

En respuesta a preocupaciones crecientes, autoridades de California y Delaware han advertido sobre la salvaguarda de usuarios jóvenes. OpenAI no se ha quedado atrás; están en proceso de implementar un sistema de predicción de edad para identificar y proteger a los usuarios menores. Además, se están introduciendo evaluaciones para medir la dependencia emocional y las emergencias de salud mental no suicidas.

El Futuro de la IA en la Salud Mental

A pesar de los avances, aún existen modelos de IA más antiguos que son considerados menos seguros y permanecen accesibles. Esto presenta un desafío significativo para la empresa y la industria en general. La gestión responsable de tecnologías como ChatGPT será fundamental en un futuro cercano, no solo para mitigar riesgos, sino para maximizar el beneficio que estas herramientas puedan ofrecer a quienes más lo necesitan en momentos de crisis.